第一步:整理与重构

阅读与理解

视频内容主要介绍了Joy Caption反推提示词插件的安装教程,以及如何解决安装过程中可能遇到的报错和冲突问题,同时提供了环境配置的指导。此外,视频还附带了Comfyui纯净整合包,以及对其他相关AI模型和工作流的介绍。

主题归类

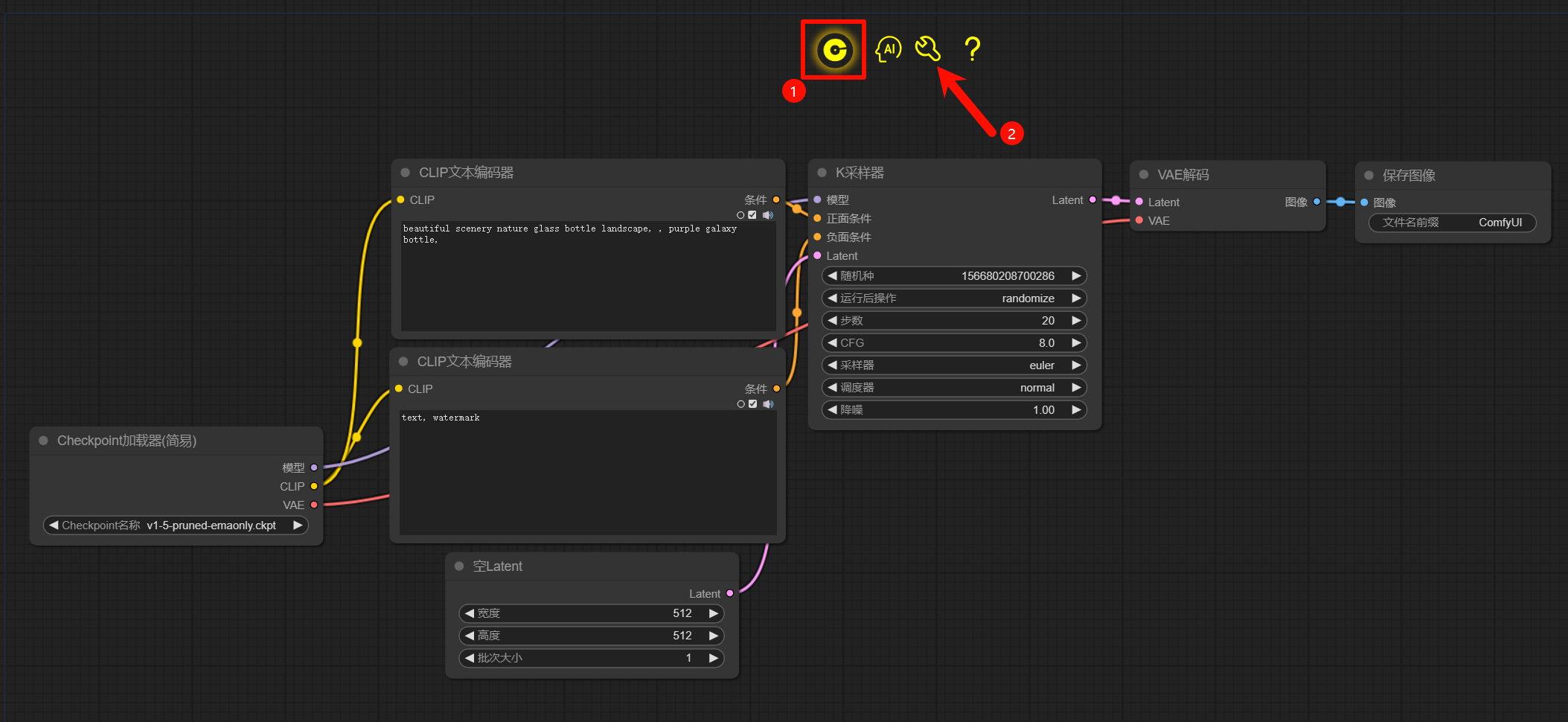

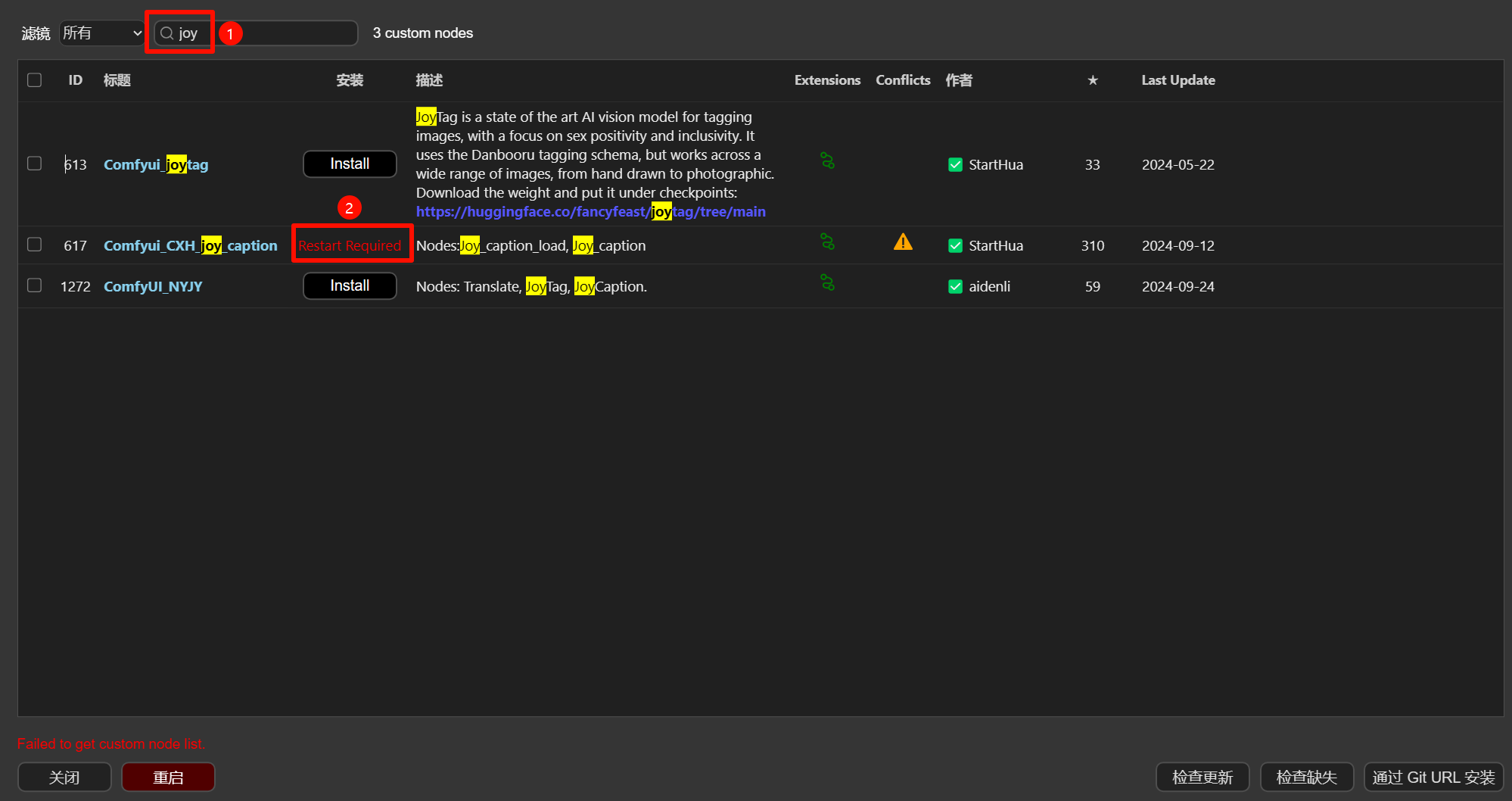

- Joy Caption插件介绍与安装

- 保姆式安装教程

- 解决报错和冲突问题

- 环境配置指导

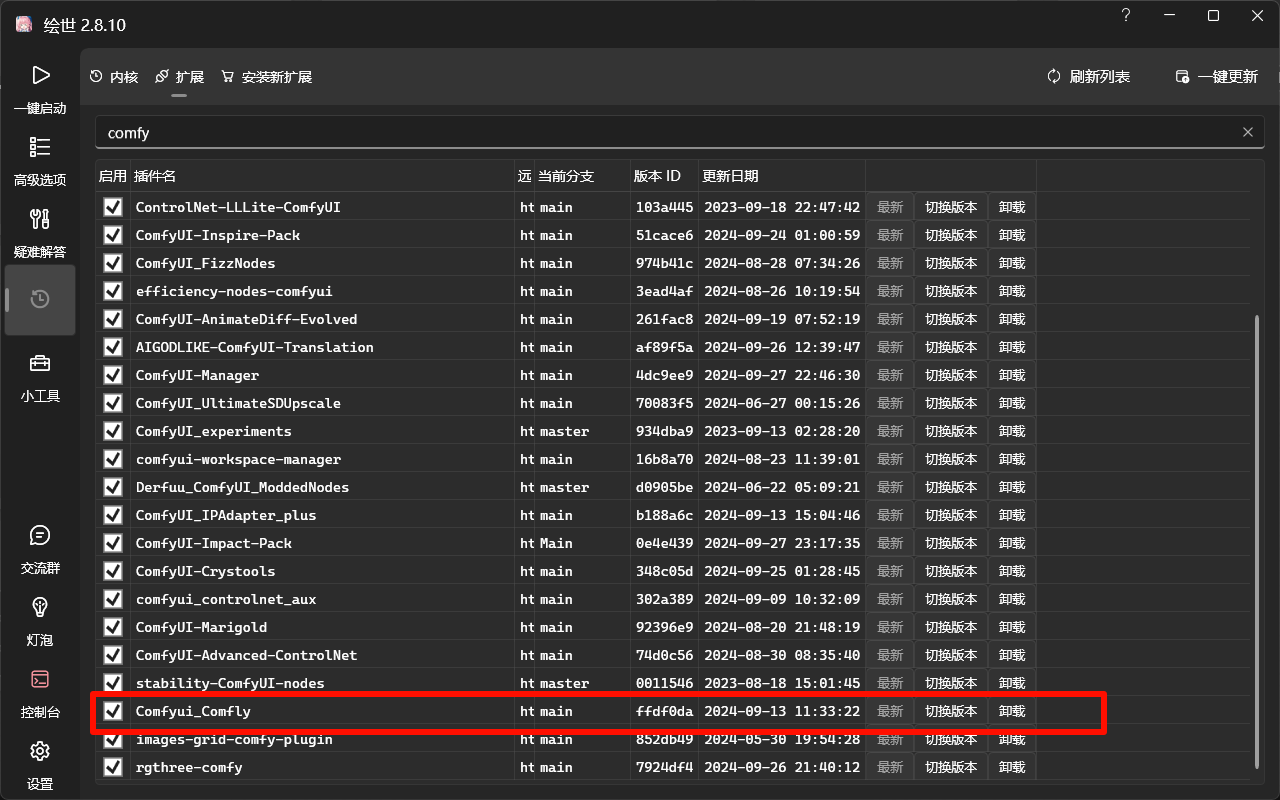

- Comfyui纯净整合包

- 提供Comfyui纯净整合包信息

- 其他AI模型和工作流

- 介绍StableDiffusion、COSXl EDIT模型、SD3开源模型等

- 介绍百度Hallo数字人技术

- 介绍电商摄影工作流和Kolors可图模型

- 技术优势与性能测试

- Flux Turbo模型性能测试

- 比较Flux与其他模型的性能

- 活动与激励

- 参与动画种草活动,赢取现金奖励

润色与优化

- 优化语言表达,确保简洁明了。

- 保留关键信息和数据,确保信息完整性。

添加标题

- Joy Caption安装与配置

- Comfyui纯净整合包

- AI模型与工作流介绍

- 性能测试与比较

- 活动与激励

第二步:要点提炼

要点1:Joy Caption插件的详细安装教程

- 主要论点:Joy Caption插件提供了保姆式的安装教程,帮助用户解决安装过程中的问题。

- 支撑论据:

- 提供了解决报错和冲突问题的指导。

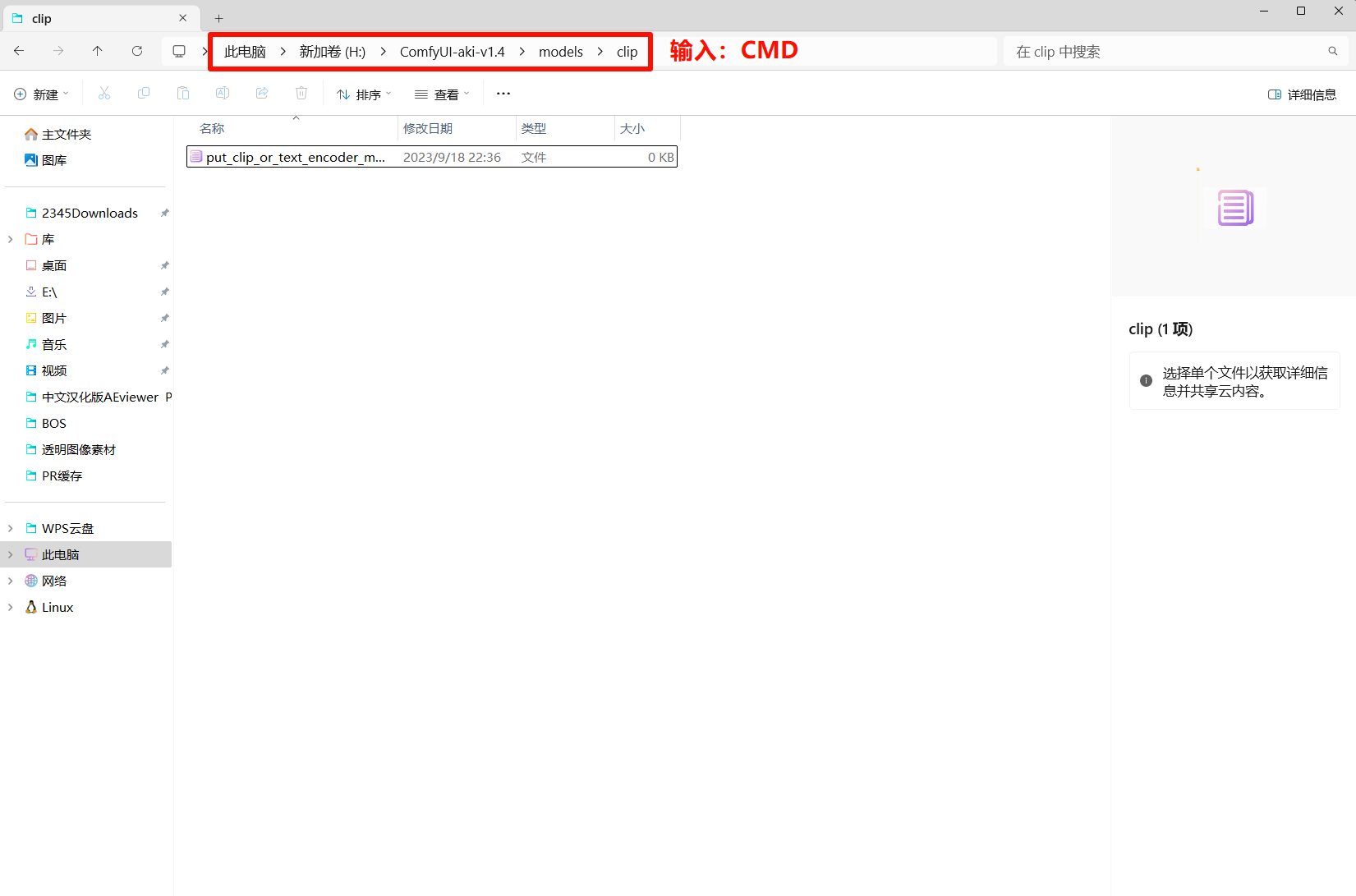

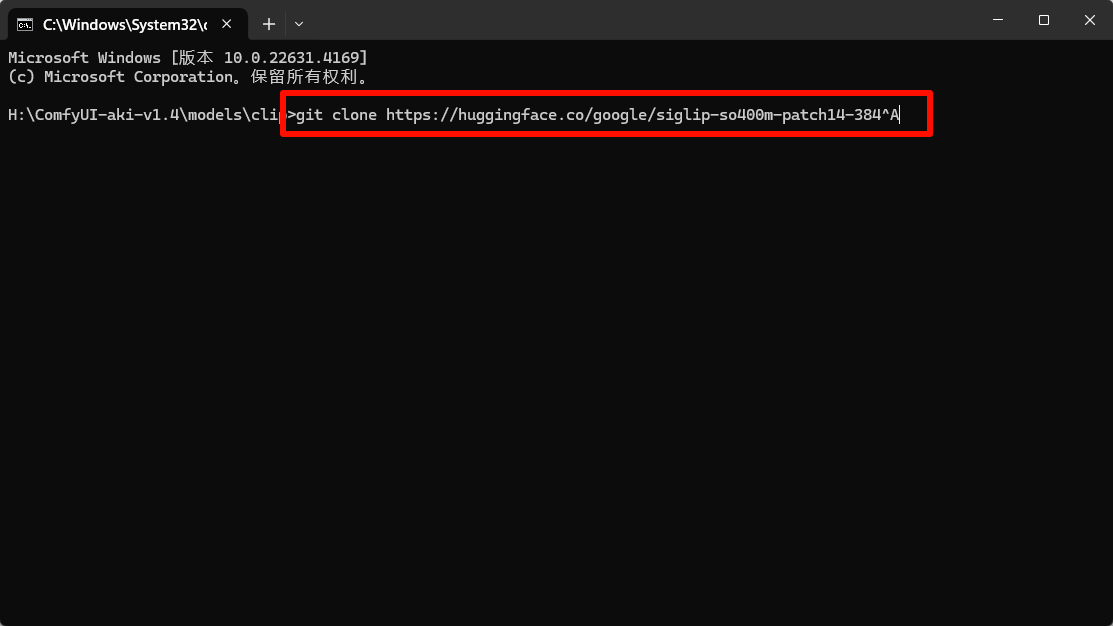

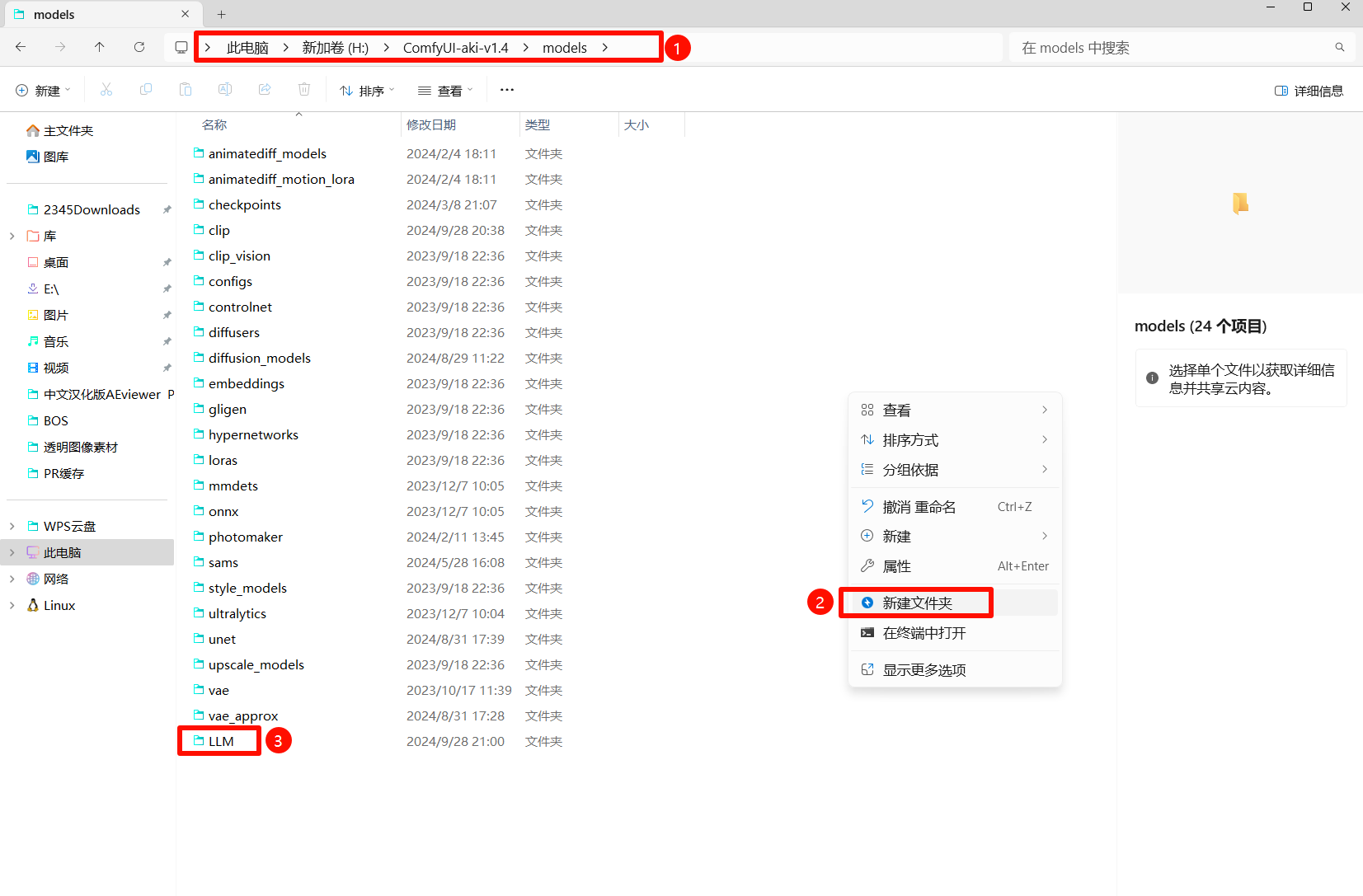

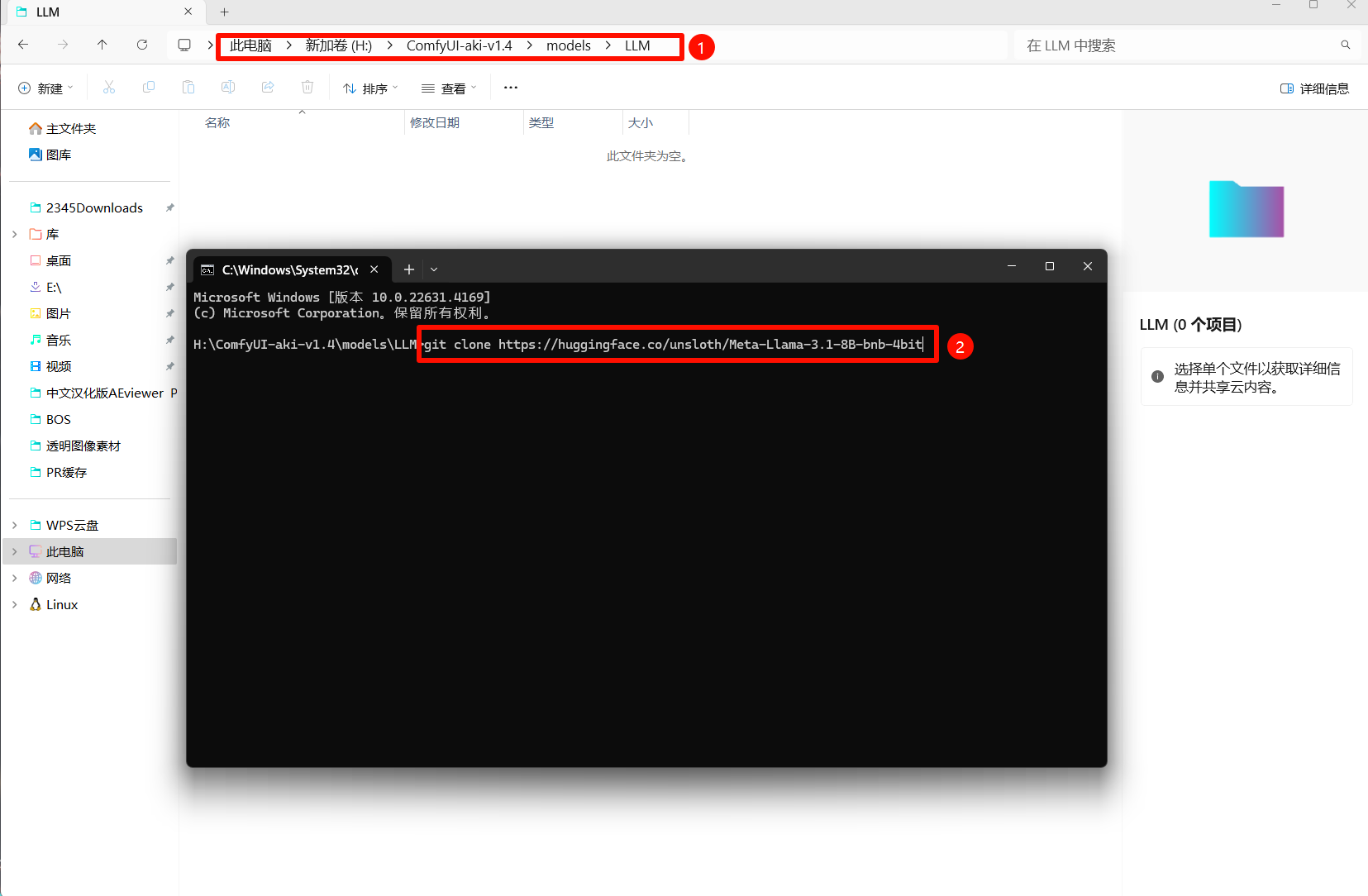

- 提供了环境配置的详细步骤。

要点2:Comfyui纯净整合包的提供

- 主要论点:视频附带了Comfyui纯净整合包,方便用户快速部署和使用。

- 支撑论据:

- 纯净整合包简化了用户的安装流程。

- 提供了商务联系方式,便于用户获取更多支持。

要点3:AI模型与工作流的多样性

- 主要论点:视频介绍了多种AI模型和工作流,为用户提供了丰富的选择。

- 支撑论据:

- 介绍了StableDiffusion、COSXl EDIT模型等。

- 提供了电商摄影和Kolors可图模型的工作流介绍。

要点4:性能测试与优化

- 主要论点:Flux Turbo模型的性能测试显示了其在速度和效率上的优势。

- 支撑论据:

- 测试结果显示Flux Turbo模型生成速度快。

- 提供了优化软硬件以提高生成速度的秘籍。

第三步:提取反共识观点

观点1:AI模型的易用性与普及

- 独到之处:视频强调了AI模型的易用性,预示着AI技术在非专业领域的普及。

- 简要阐释:随着Joy Caption等插件的保姆式安装教程和Comfyui纯净整合包的提供,AI技术的使用门槛降低,使得非专业人士也能轻松使用,这可能会推动AI技术的普及和应用。

观点2:国产AI模型的竞争力

- 独到之处:Kolors可图模型作为国产开源模型,显示了国产AI技术的竞争力。

- 简要阐释:Kolors模型支持中文输入,并且在性能上优于MidJourney v6和DALLE 3,这表明国产AI模型在技术和应用上具有竞争力,能够与国际主流模型相媲美。

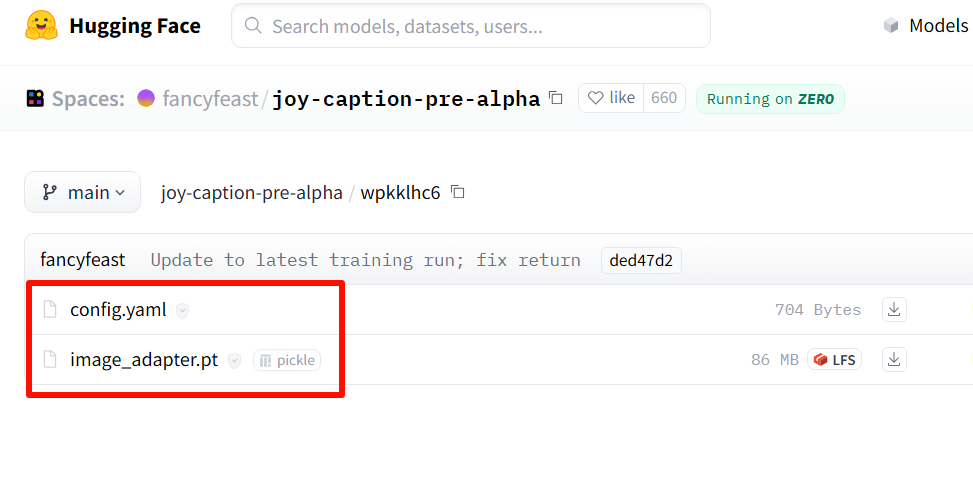

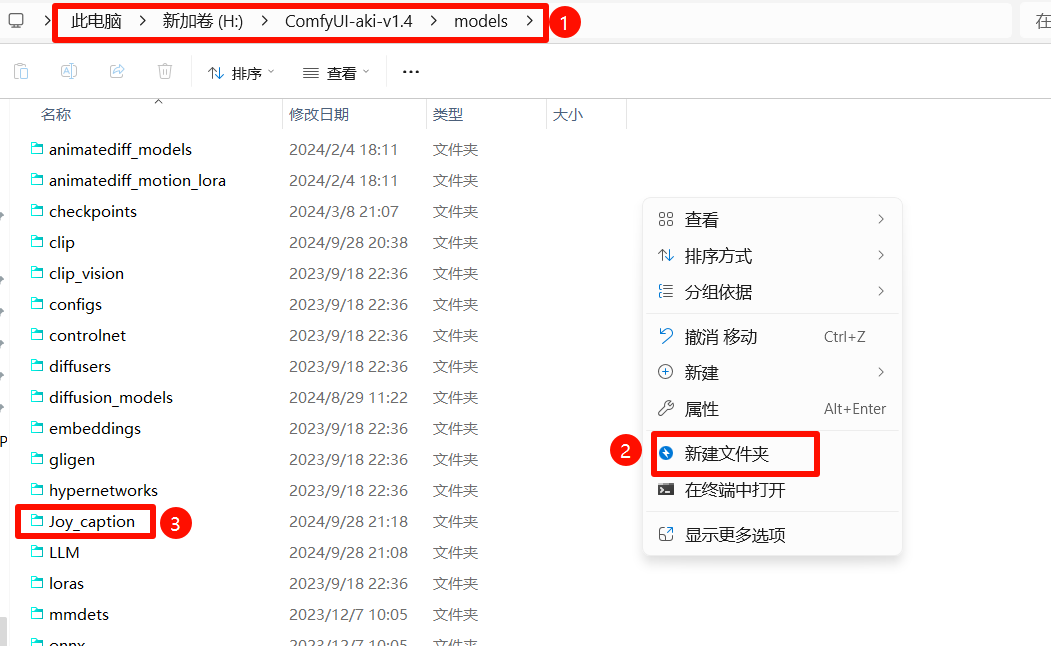

JoyCaption安装部署以及报错问题解决方式:

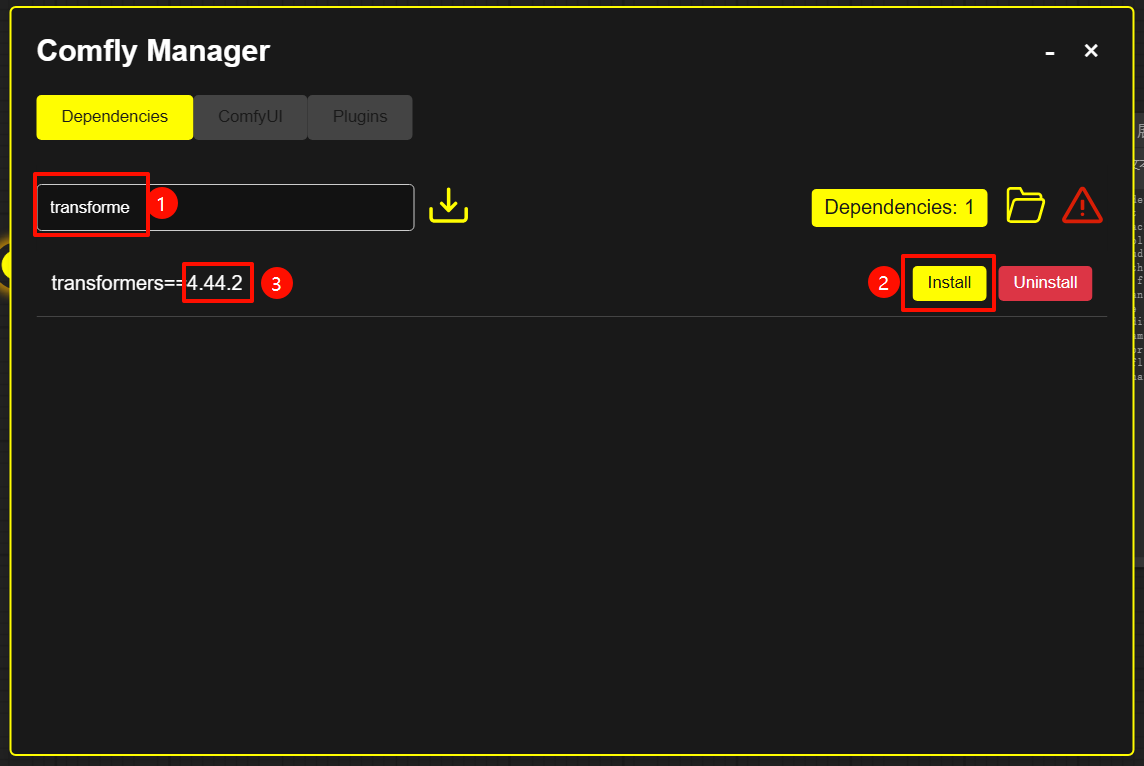

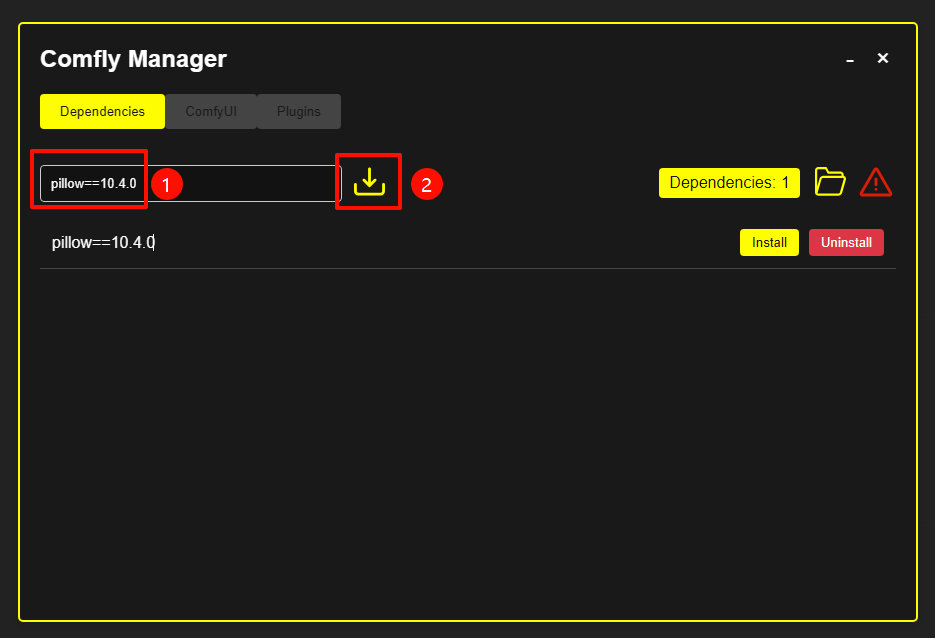

安装4.44.2版本

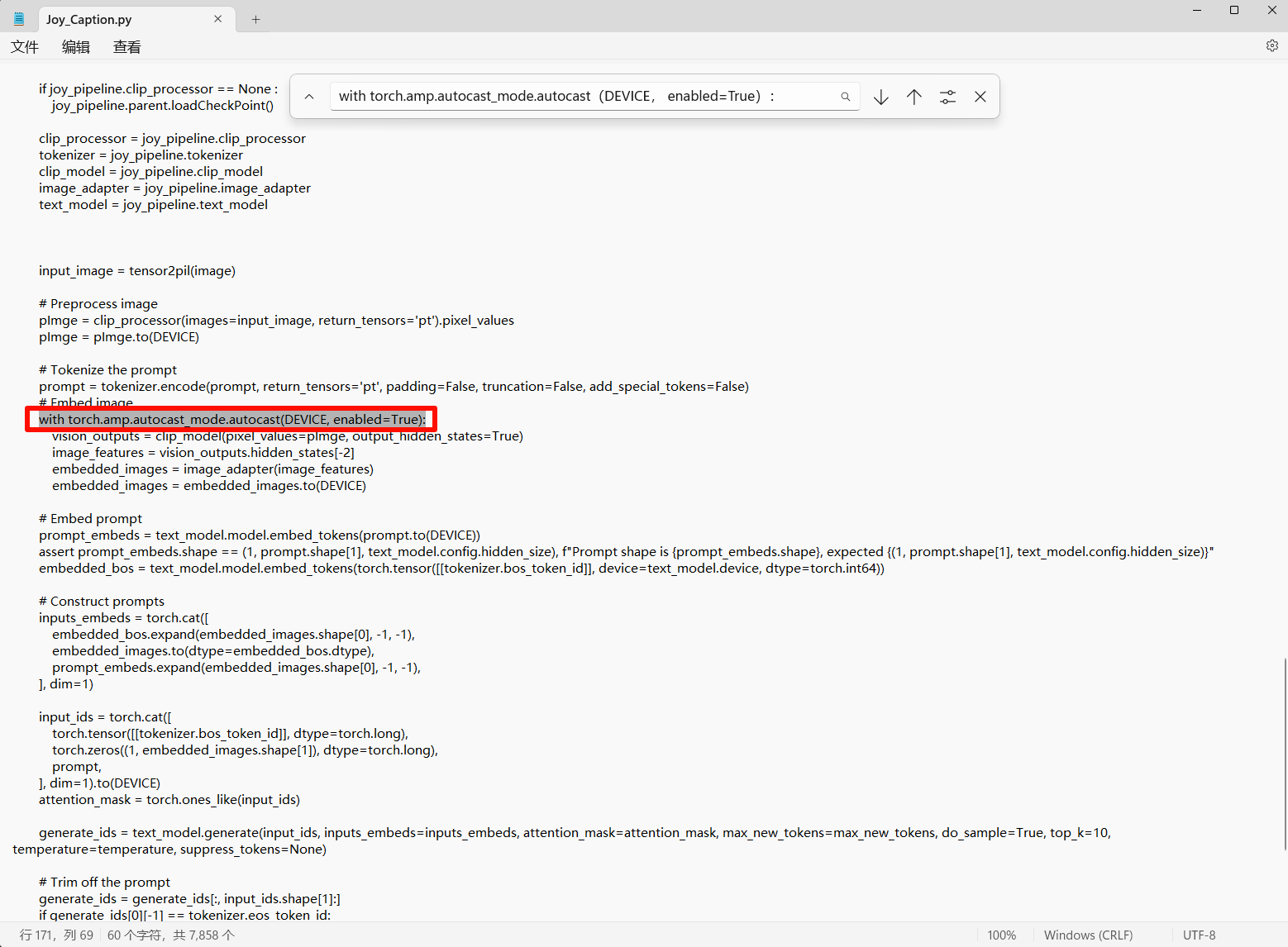

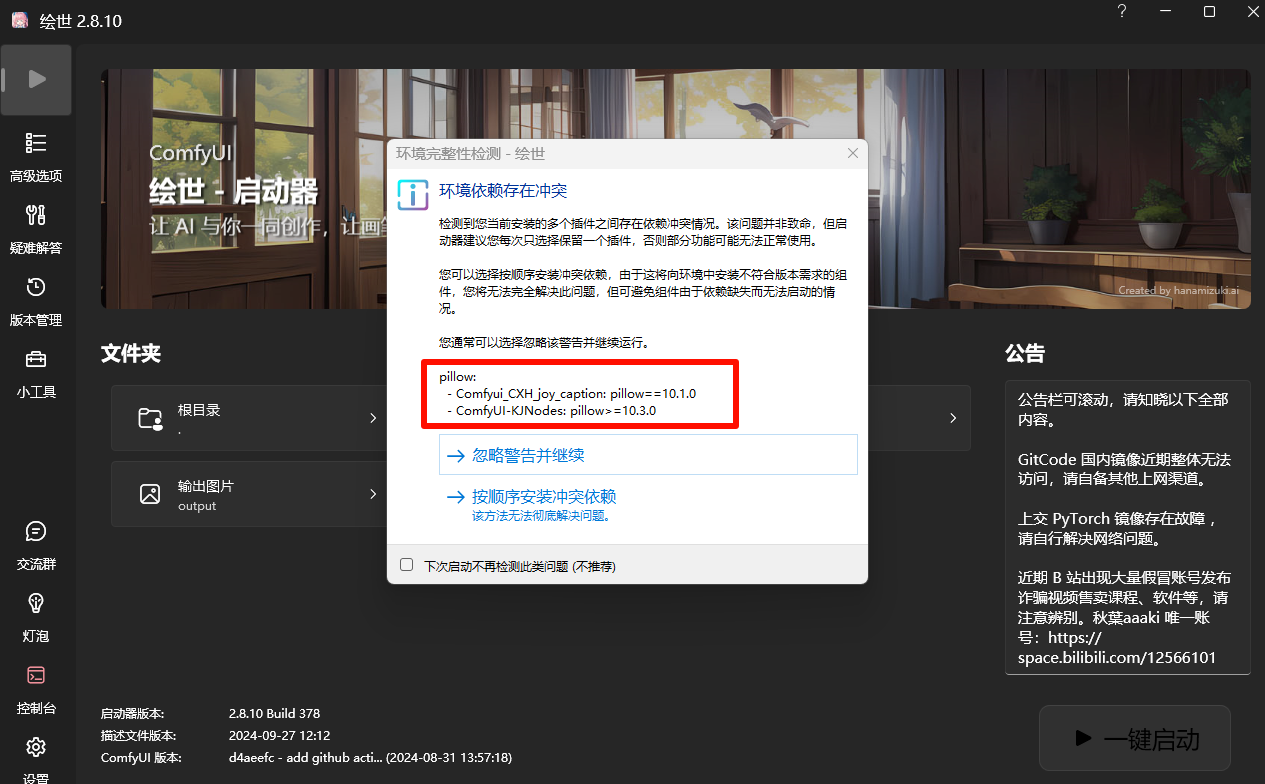

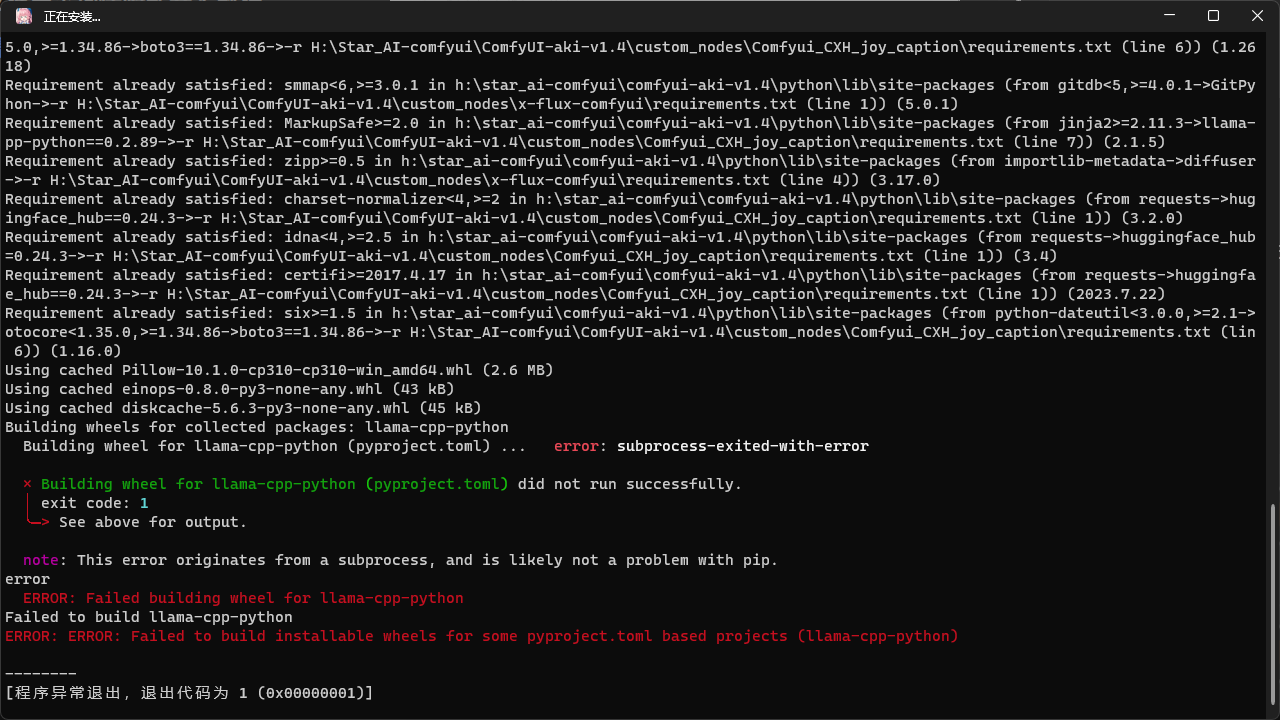

报错问题解决方法:

with torch.amp.autocast_mode.autocast(DEVICE, enabled=True):

修改为:

with torch.amp.autocast_mode.autocast(device_type=’cuda’, enabled=True):

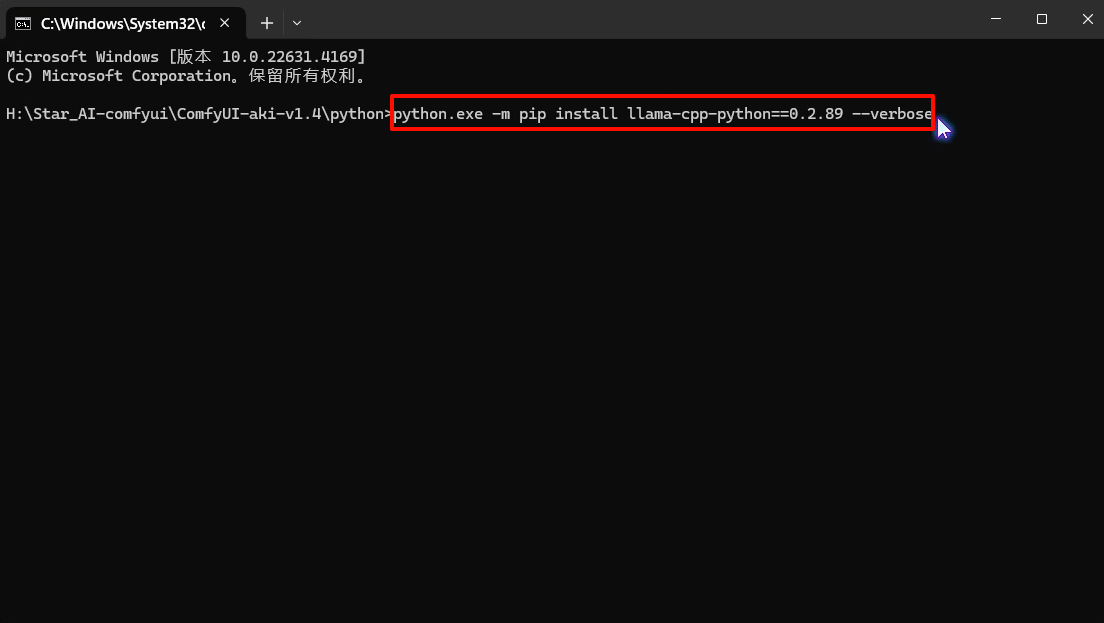

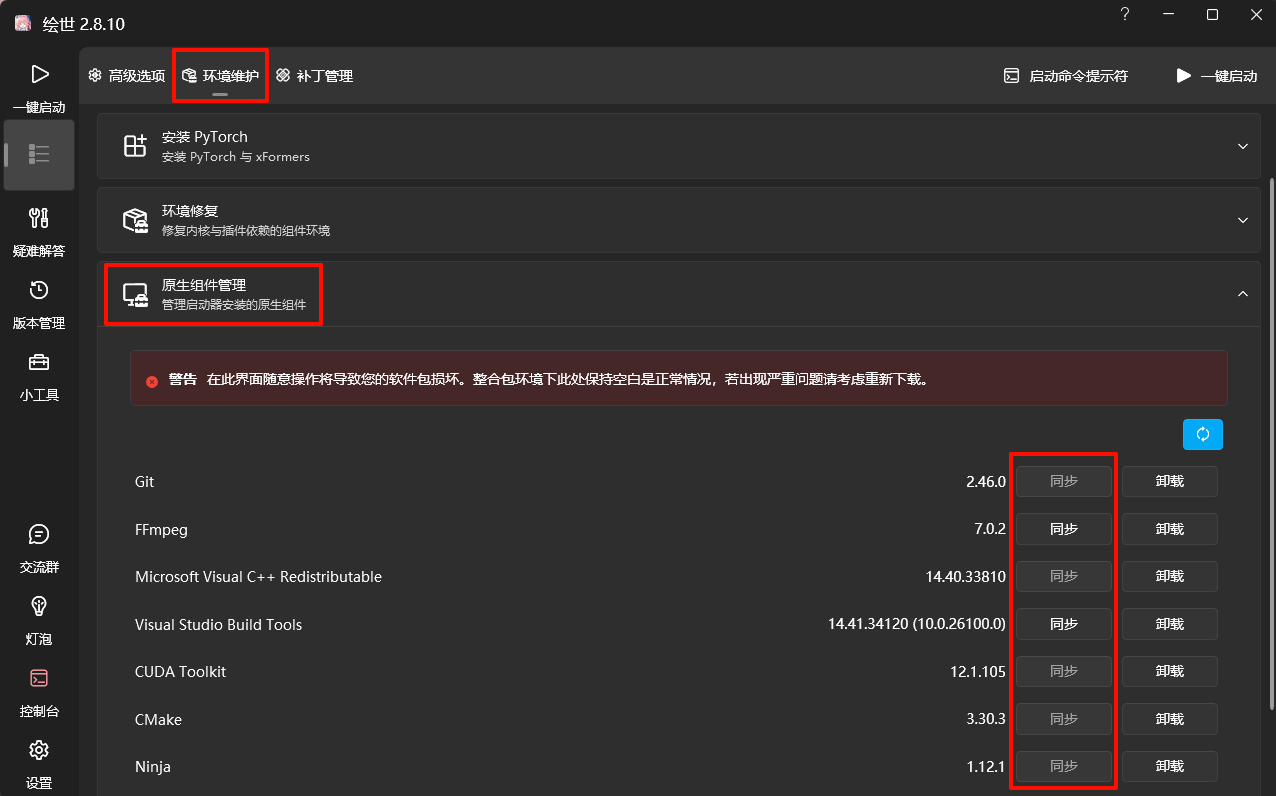

确保本地安装了VS2022与C++

重新安装此版本:pip install llama-cpp-python=0.2.89 –verbose

以上是大部分人遇到的问题解决方案,有可能会出现我没发现的错误信息

可以积极在评论区交流讨论

实在不会的可以到项目页查看,或者吧报错问题丢给GPT询问

课件资料:

- 夸克:https://pan.quark.cn/s/5df7a4c8270a

桂公网安备 2026003020 号

桂公网安备 2026003020 号